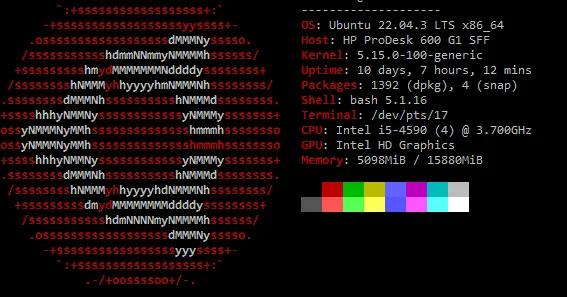

No meu caso, eu empaquei aí porque no link de destino aparentemente é obrigatório ser um A record ( https://prosody.im/doc/dns#srv_records ), mas como todos os meus selfhosts são usando o argo tunnel do cloudflare, todos os meus (sub)domínios são CNAME.

E não consegui achar em nenhum canto alguém falando como rodar um servidor xmpp pelo argo.

Mas quem leva o título no site da notícia é a Taylor Swift? Tá serto…